BERT阅读与总结最近google放出的BERT引起了NLP领域很大的反响,在11项NLP tasks中取得了state-of-the-art的结果,包括NER、问答等领域的任务。看完论文和网上的讨论,总结了几个关键点。

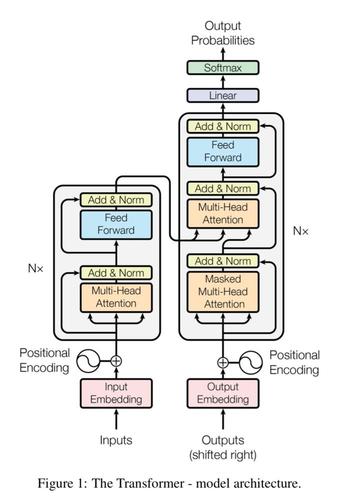

BERT模型结构B

2018-12-11